2018.04.07:

论文阅读

这篇文章的核心思想是比较精炼概括的,它的亮点是用一个框架解决了在计算机视觉中常见的任务中经常遇到的两个通用环节:Detection and Grouping,用中文来讲就是,检测(小的视觉单元作为候选)和(根据得分)重组(一个合理的结构)。

杨森

2018.04.07:

这篇文章的核心思想是比较精炼概括的,它的亮点是用一个框架解决了在计算机视觉中常见的任务中经常遇到的两个通用环节:Detection and Grouping,用中文来讲就是,检测(小的视觉单元作为候选)和(根据得分)重组(一个合理的结构)。

由显式的图模型推断人体铰链模型到隐式地表达丰富的多部件关系的转折点!

估计铰链式人体姿态的复杂度来源有两个:

传统的图模型,基于树结构或者星状结构的简单图模型难以捕捉多部件之间的关系和依赖性,而且容易导致双重计数错误产生。 非树模型需要近似推断来解决,参数学习非常复杂!

善有善报,恶有恶报。

虽然世间并没有将这份准则执行地那么恰如其分,但是万物归根结底,必然有着因果之间的联系。

而人生匆匆,为什么愚蠢的我们总是在苦苦寻觅事情的答案,why?

剪不断,理还乱,只好奉上因果推断

在生活中,聪明的人常常告诫我们,不要给事物轻易下定义,不要轻易给他人打上标签,因为“标签”的一种贬义替代词汇是“偏见”。然而目前的机器学习正利用人类的标签思维进行学习,所以机器学习到头来,学习到的都是我们的偏见吗?

我们首先来谈论一下端到端的学习。什么是端到端学习?简单来讲就是,机器学习一个从特定输入到特定输出的过程。端到端的学习应该在深度学习产生后进入了巅峰状态。对物体特征的提取技术由手工设计,如(HOG、Har、SIFT、LBP等),被自动提取技术(CNN)所替代了,少了人工的介入,那么端到端就能够轻易实现了。但实际上,端到端是一种局限的智能,为什么说它是局限的?一方面,它导致了模型的黑箱化,不可解释性,即我们不能认知中间特征数据所表示的内涵,另外,一个样本的信息量是巨大的,若是从不同的角度去解读,提取它的内涵就会得到不同的“标签”,甚至可以提取出内涵对立的标签(比如,如果我们特意地让机器去区分人类和动物的差异,机器就不能学习到,人类本身就是动物,这一基本事实),然而机器将大量相似的图像进行归纳学习为一个单独的标签,那么模型学到的是一种呆板的、偏见的抽象,这绝对不是真正的智能,就像Judeal Pearl说的如今的机器学习就是曲线拟合而已。

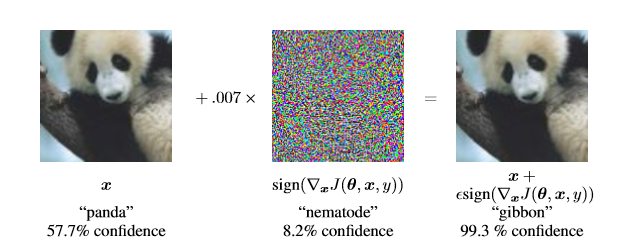

近来的研究表明 DNN 容易受到对抗样本(adversarial example)的影响:在输入中加入精心设计的对抗扰动(adversarial perturbation)可以误导目标 DNN,使其在运行中给该输入加标签时出错。

一个常见的对抗攻击来自于2014年Goodfellow提出的Fast Gradient Sign Method(FGSM),它通过在梯度方向上进行添加增量来诱导网络对生成的图片X’进行误分类 \[ x^{,}=x+\varepsilon sign(\bigtriangledown _{x} J(\theta ,x,y)) \]